ios

mysql

导航

rce

部署

考研

单例模式

python内置函数

YoloV5

生活

Tableau

免责声明

逆向

两数之和

conda

qt编程

前后端分离考试系统

相机参数

protobuf

GPT-4

jsoup

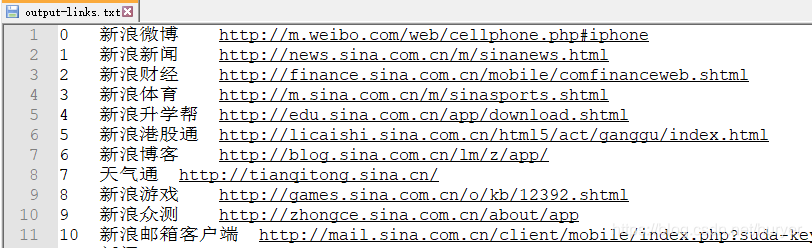

2024/4/12 13:04:52kettle+jsoup解析网页url链接

用途

本文介绍如何使用kettle,遍历web页面中的url链接,并输出到文本文档。

技术

kettle javascript jsoup-1.11.3.jar

转换文件步骤 生成记录

此步骤用于设置需要访问的web地址,以sina为例:

JavaScript代码 源码如下&#…

Jsoup+HtmlUnit获取懒加载数据

需要的包: <dependency><groupId>org.projectlombok</groupId><artifactId>lombok</artifactId><scope>provided</scope><version>1.16.20</version></dependency> <dependency><groupId>…

最基本的网页爬虫(数据采集)

经常看到一些交流网页爬虫的初学者来问有没有教程,什么是爬虫呢?(ps:不是爬虫类,记得最搞笑的是一个交流这个主题的群,有人进来发广告,广告的内容则是卖蜥蜴、变色龙之类的爬虫)。ok,言归正传,什么是网络爬…

12.java程序员必知必会类库之HTML解析库

前言

HTML是开发经常遇见的一种报文格式。但是我们日常中,更多是用它来渲染数据。利用他的很多各种标签,格式化我们的数据。一般前端接触的比较多。

但是,随着爬虫技术在互联网上越来越流行,如何处理我们爬到的HTML。。。我们当…

SpringBoot使用jsoup爬取HTML

原文网址:SpringBoot使用jsoup爬取HTML_IT利刃出鞘的博客-CSDN博客

简介

本文介绍SpringBoot--使用jsoup(Java爬虫工具)的方法。

jsoup 是一款 Java 的 HTML 解析器,它提供了一套非常便利的 API,可通过 DOM、CSS 通过类似于 JQuery 的操作…

Java爬取中国高校的信息,实现高效下拉选

事情背景

最近帮朋友做一个小项目,里面涉及到中国高校信息的下拉选。就去网上搜索一下相关信息,总结了一下,还是把这些信息控制在自己的手里比较好,就尝试用Jsoup去爬取中国高校信息。

准备工作

1.爬取网址:校园信息…

Android基础学习总结(十三)——利用jsoup解析html实现网络爬虫

引言

很多时候,我们需要从各种网页上面抓取数据,而 jsoup 是一款Java 的HTML解析器,可直接解析某个URL地址、HTML文本内容。它提供了一套非常省力的API,可通过DOM,CSS以及类似于jQuery的操作方法来取出和操作数据。我…

Android网络爬虫程序(基于Jsoup)

摘要:基于 Jsoup 实现一个 Android 的网络爬虫程序,抓取网页的内容并显示出来。写这个程序的主要目的是抓取海投网的宣讲会信息(公司、时间、地点)并在移动端显示,这样就可以随时随地的浏览在学校举办的宣讲会信息了。…

万法归宗之Hadoop编程无界限

记录下,散仙今天的工作以及遇到的问题和解决方案,俗话说,好记性不如烂笔头,写出来文章,供大家参考,学习和点评,进步,才是王道 ,废话不多说,下面切入主题&…

Java网络爬虫技术《二》Jsoup

Jsoup

当我们成功抓取到页面数据了之后,还需要对抓取的数据进行解析,而刚好,Jsoup 是一款专门解析 html 页面的技术。Jsoup是一款基于 Java 的HTML 解析器,可直接解析某个 URL 地址、HTML 、文本内容。可以通过DOM、CSS以及类似于…

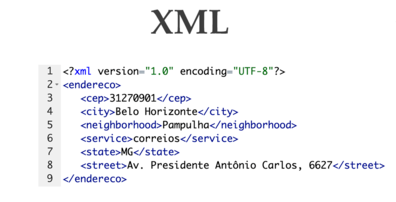

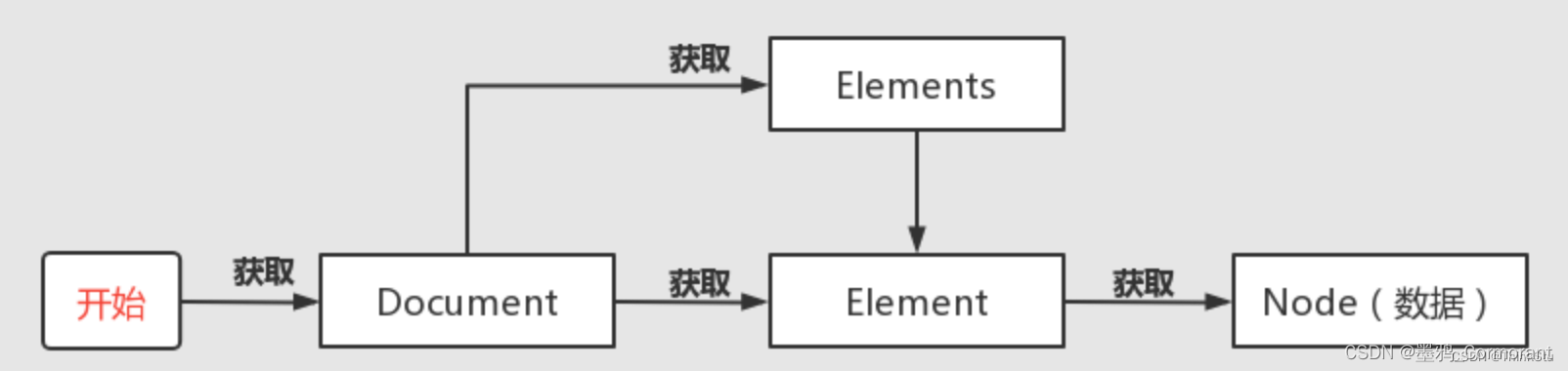

JAXP、DOM4J、Jsoup、JsoupXPath等常用XML解析器的使用

JAXP、DOM4J、Jsoup、JsoupXPath等常用XML解析器的使用XML概述组成部分XML示例约束XML的解析JAXP的使用准备student.xml文件解析XML文档写入XML文档dom4j的使用Document对象获取方式引入依赖解析XML文档文档写入XMLJsoup的使用引入依赖核心对象解析XML文档JsoupXPath的使用引入…

Jsoup模拟登陆例子

[b][sizelarge][colorgreen]Jsoup模拟登陆小例子,不同的网站,需要不同的模拟策略,散仙在这里仅仅作为一个引导学习。[/color][/size][/b]package com.jsouplogin;import java.util.HashMap;import java.util.List;import java.util.Map;impor…

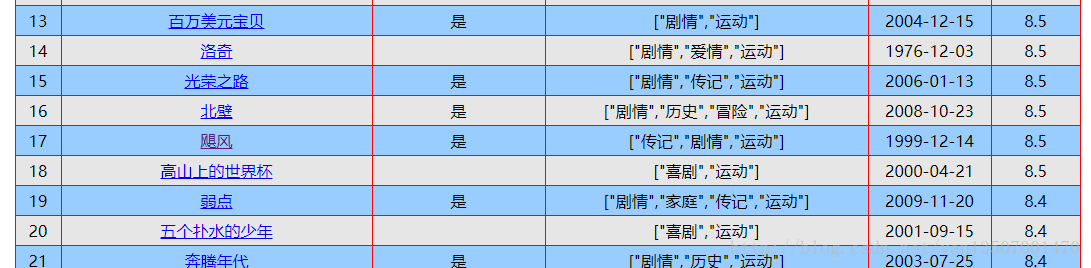

java爬取某电影网站数据

使用jsoup获取动态网站的数据

部分代码:

/*** 获取分类的所有相对链接地址 和名称,保存到map中,返回数据**/

public class GetMoviesName {private String url;HashMap<String, String> hrefandname new HashMap<String, Strin…

jsoup 框架的使用指南

概述

参考:

官方文档jsoup的使用JSoup教程jsoup 在 GitHub 的开源代码

概念简介

jsoup 是一款基于 Java 的 HTML 解析器,它提供了一套非常省力的 API,不但能直接解析某个 URL 地址、HTML 文本内容,而且还能通过类似于 DOM、CS…

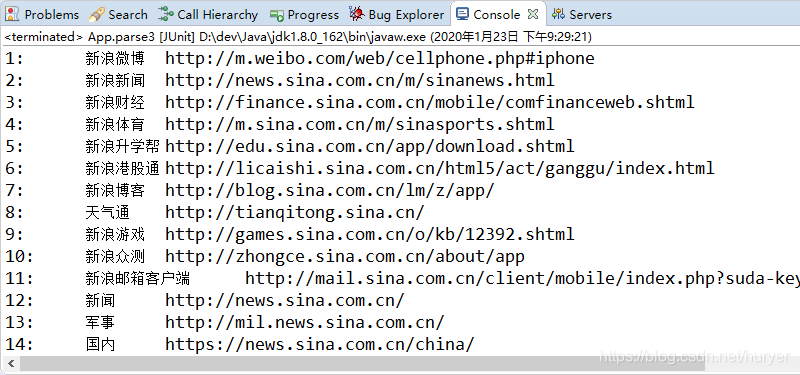

java 如何遍历html页面的url连接

功能描述

本文以获取sina首页为例,描述如何使用java获取web页面中的url链接地址。

示例代码 import java.io.IOException;import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

import org.jsoup.nodes.Element;

import org.jsoup.select.Elements;

import …

解析神器PK,花落谁家?Jsoup Or Xpath?

[b][colorgreen][sizelarge]

今天简单测了下使用Jsoup和Xpath解析XML的文件的方便程度,两者都可以完成解析,提取特定的元素或节点内容,但明显Jsoup更胜一筹,我们都知道Xpath是专业的xml结构化文档的查询语言,虽然语法功…

Java爬虫的使用案例及简单总结

通过三个简单的案例,来实现的,都是不加验证的情况下. 如果有拼图验证网上也有对应的实现方法自行查找即可. 这里仅仅是一个简单的Demo, 练习使用 0. 爬取网站的配置:

article:config:#中央新闻网-三农头条数据部分ntvUrl: https://www.ntv.cn/# 全国农技推广网- 农技动态部分n…

java解析html

目录 场景描述一.引入依赖二.调用接口响应回来的html三.测试代码 场景描述 我调用外部接口,但是返回来的数据是html的格式,所以我就需要进行处理来获得我想要的数据。我使用的是jsoup。 一.引入依赖

<dependency><groupId>org.jsoup</gr…

【数据爬取】Jsoup爬取数据的使用

目录 1.Jsoup介绍2.导入依赖3.爬虫示例 1.Jsoup介绍 Jsoup 是一个用于解析、提取和操作 HTML 文档的 Java 库。它提供了简单且易于使用的 API,能够轻松地从 HTML 页面中提取数据。 2.导入依赖

<dependency><groupId>org.jsoup</groupId><arti…

使用Jsoup.clean消除不受信任的HTML (防止XSS攻击)

转自:[Jsoup] 使用Jsoup消除不受信任的HTML (防止XSS攻击)

防止XSS攻击的策略个人总结大致有几种: - 使用正则设置白名单/黑名单进行过滤 - 通过dom对象进行黑名单/白名单的过滤 - 使用第三方类库Jsoup/AntiXSS等进行过滤HTML标签来防止XSS 本文章…

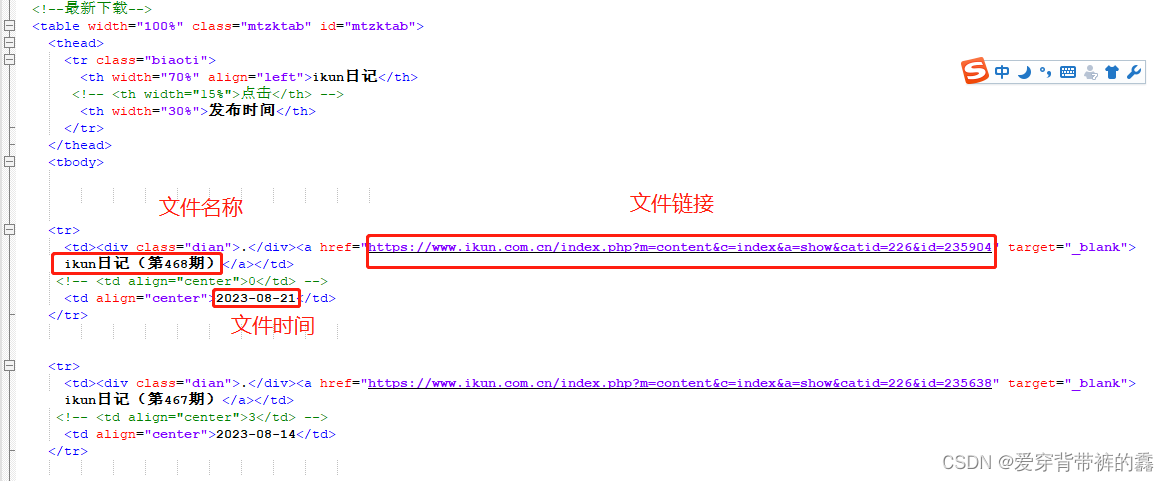

记录一下Java格式化Html的操作,复制网页源码为txt格式,使用jsoup找到目标数据,搞事情之前一定要分析清楚需求

单位要考试了,有个题库2000多道题,手机上只能一下一下点,太麻烦了!

这重复的操作竟然如此熟悉,害! 写个小工具 搞定它!

说干就干。

搞事情前,一定要弄清楚需求,逻辑分…

Jsoup 爬取页面的数据和 理解HTTP消息头

推荐一本书:黑客攻防技术宝典.Web实战篇 ; 顺便留下一个疑问:是否能通过jsoup大量并发访问web或者小型域名服务器,使其瘫痪?其实用jsoup熟悉的朋友可以用它解析url来干一件很无耻的事(源码保密)…

CSDN爬虫抓取博客排名和访问量并发送邮件

github 地址

csdnranks

csdnranks

CSDN Ranks Autotask

A crawler for CSDN blog,count the visiter number and the rank of the whole station.

一个CSDN博客的爬虫,用来统计访问量和排名。

Function List

1.pull the nums and ranks

2.save data to mysq…